Künstliche Intelligenz (KI) kann Smart Contracts mittlerweile etwa doppelt so effektiv ausnutzen, wie sie Schwachstellen erkennt, so Binance Research.

KI steht im Mittelpunkt der Diskussion um Hacks in der Kryptowährungsbranche. Viele Analysten vermuten zunehmend, dass Angreifer diese Werkzeuge nutzen, um DeFi-Angriffe durchzuführen.

Warum die Kluft zwischen Angriff und Verteidigung bei KI wächst

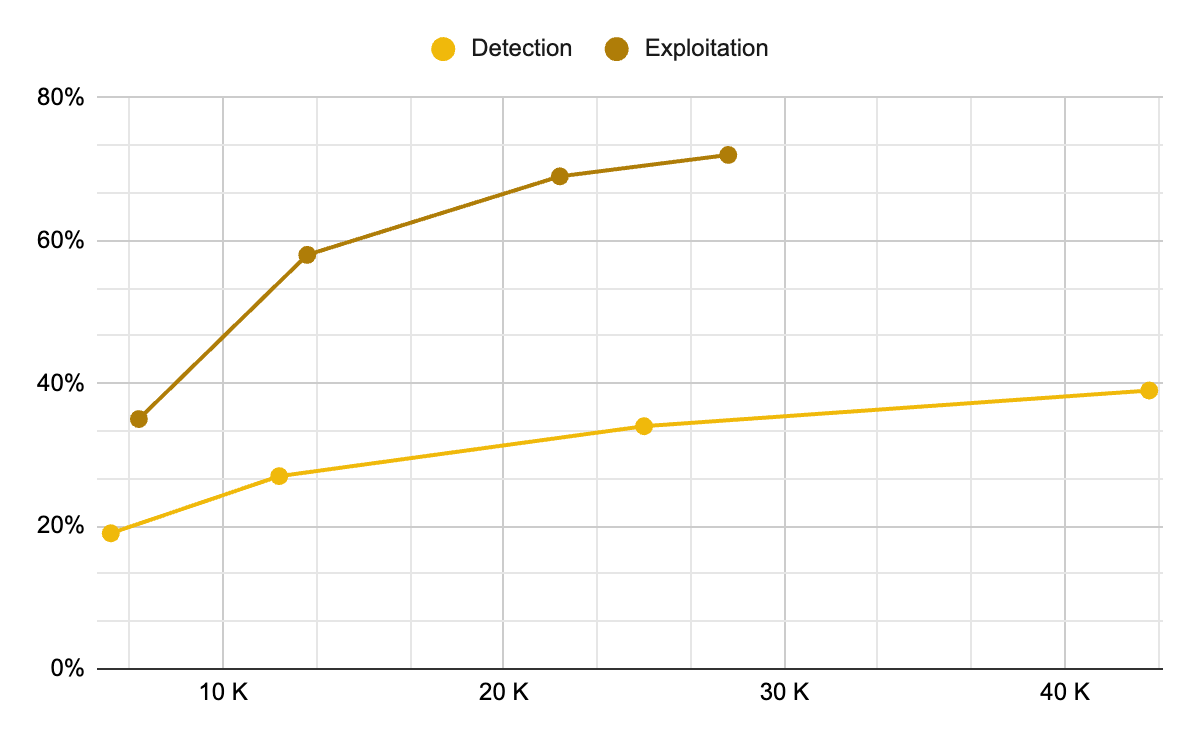

Laut einem aktuellen Bericht von Binance Research erreicht GPT-5.3-Codex im „Exploit“-Modus bei EVMbench eine Erfolgsquote von 72,2 %. Im „Detect“-Modus liegt die Erfolgsquote hingegen bei etwa der Hälfte.

„Ob wir es wollen oder nicht, KI ist derzeit doppelt so gut im Ausnutzen wie im Erkennen“, heißt es im Bericht. „Die wirtschaftlichen Bedingungen begünstigen nun Angreifer.“

Zum Hintergrund: EVMbench ist ein Maßstab, der prüft, wie gut KI-Modelle schwerwiegende Sicherheitslücken in Smart Contracts erkennen, beheben und ausnutzen können. Der Benchmark basiert auf 117 sorgfältig ausgewählten Schwachstellen aus 40 Audits.

Smart Contracts verwalten Milliarden an Nutzervermögen im Bereich DeFi. Dieser quelloffene Code macht sie zu idealen Zielen für automatisierte Prüfungen. KI-Systeme können Tausende Verträge in Minuten und zu sehr geringen Kosten durchsuchen.

Die Kluft zwischen Angriff und Verteidigung vergrößert sich, weil die Kosten für Angriffe weiter sinken. Daten von Binance Research zeigen, dass KI-gestützte Angriffe im Schnitt etwa 1,22 USD pro Smart Contract kosten. Dieser Betrag soll alle zwei Monate um weitere 22 % sinken.

„Die SSDLC Maturity Survey von Hacken zeigt, dass mittlerweile über 80 % der Entwickler KI bei der Entwicklung nutzen, aber weniger als 40 % setzen KI für umfassende Tests ein, wodurch die Kluft zwischen Angriff und Verteidigung strukturell bestehen bleibt“, so Binance Research weiter.

Die Bedrohung geht jedoch über statischen Code hinaus. Analysten von TRM Labs vermuten inzwischen, dass nordkoreanische Hacker KI auch für Recherche und Social Engineering einsetzen.

Dieser Wandel könnte unter anderem Attacken wie den Drift-Hack erklären, bei denen wochenlange gezielte Manipulationen an komplexen Blockchain-Systemen durchgeführt wurden, was einen Bruch mit Nordkoreas früherem Fokus auf einfache Kompromittierungen privater Schlüssel darstellt.

Folgen Sie uns auf X, um immer die neuesten Nachrichten zu erhalten

KI verändert die Dynamik bei Krypto-Betrug grundlegend

Auch im Online-Betrug hat sich die wirtschaftliche Situation stark gewandelt. Chainalysis fand heraus, dass KI-gestützte Betrugsmaschen pro Fall 4,5-mal mehr Geld einbringen als herkömmliche und zudem neunmal mehr Transaktionen erzeugen.

Die Analysten stellen fest, dass der Anstieg des Transaktionsvolumens darauf hinweist, dass Betrüger dank KI gleichzeitig viel mehr Opfer erreichen und manipulieren können. Dies ist typisch für Betrug im industriellen Maßstab.

Betrüger greifen verstärkt auf Deepfake-Technologie und KI-generierte Inhalte zurück, um überzeugende Identitätsfälschungen für Liebes- oder Investitionsbetrug zu erstellen. Besonders auffällig ist, dass Angriffe mit Identitätsfälschung im Jahr 2025 um 1.400 % gegenüber dem Vorjahr gestiegen sind.

Etwa 60 % der Branchenteilnehmer sehen den zunehmenden KI-Einsatz durch Kriminelle als wichtigsten Risikofaktor im Jahr 2025. Vor allem der Kryptowährungssektor ist davon betroffen. Die Branche ist für 88 % aller bekannten Deepfake-Betrugsfälle weltweit verantwortlich.

Abonnieren Sie unseren YouTube-Kanal, um Expertenmeinungen von Branchenführern und Journalisten zu sehen