Die Literatur hat uns gewarnt, und das seit etwa fünfhundert Jahren. Sie wiederholt immer wieder die gleiche Botschaft: Vom tonernen Golem im mittelalterlichen Prag bis zu William Gibsons von Neonlicht gefluteten neuronalen Netzwerken. Die Handlung bleibt stets gleich: Das, was wir bauen, um uns zu helfen, verändert am Ende uns selbst.

Wir haben das gelesen, genickt und das Buch zugeschlagen, nur um direkt wieder Chatbots damit zu beauftragen, unsere Hochzeitsreden, unsere juristischen Schriftsätze und sogar medizinische Ratschläge zu schreiben.

Heute bewirbt die KI-Branche eine glänzende Zukunft, in der vom Nachwuchs-Reporter bis zum wortgewandten Anwalt alle überflüssig werden. Doch während das Silicon Valley das Paradies verspricht, liefert die Realität über freundliche Chatfenster teils gefährlich falsche Ratschläge.

Dmitry Nikolsky, CPO von BitOK, sagt, es reicht. Er erklärt, warum die Menschheit damit aufhören muss, jede Verantwortung auf die pixel-dünnen „Schultern“ der KI zu legen.

Sogar Elon Musk warnte kürzlich in seiner Aussage zur OpenAI-Klage: „KI könnte uns alle töten.“

Vom Golem bis R.U.R.: Wir wollten immer einen Not-Aus-Schalter

Glauben Sie, dass die Angst vor Künstlicher Intelligenz mit Terminator begann? Das stimmt nicht. Diese Sorge ist älter als Strom.

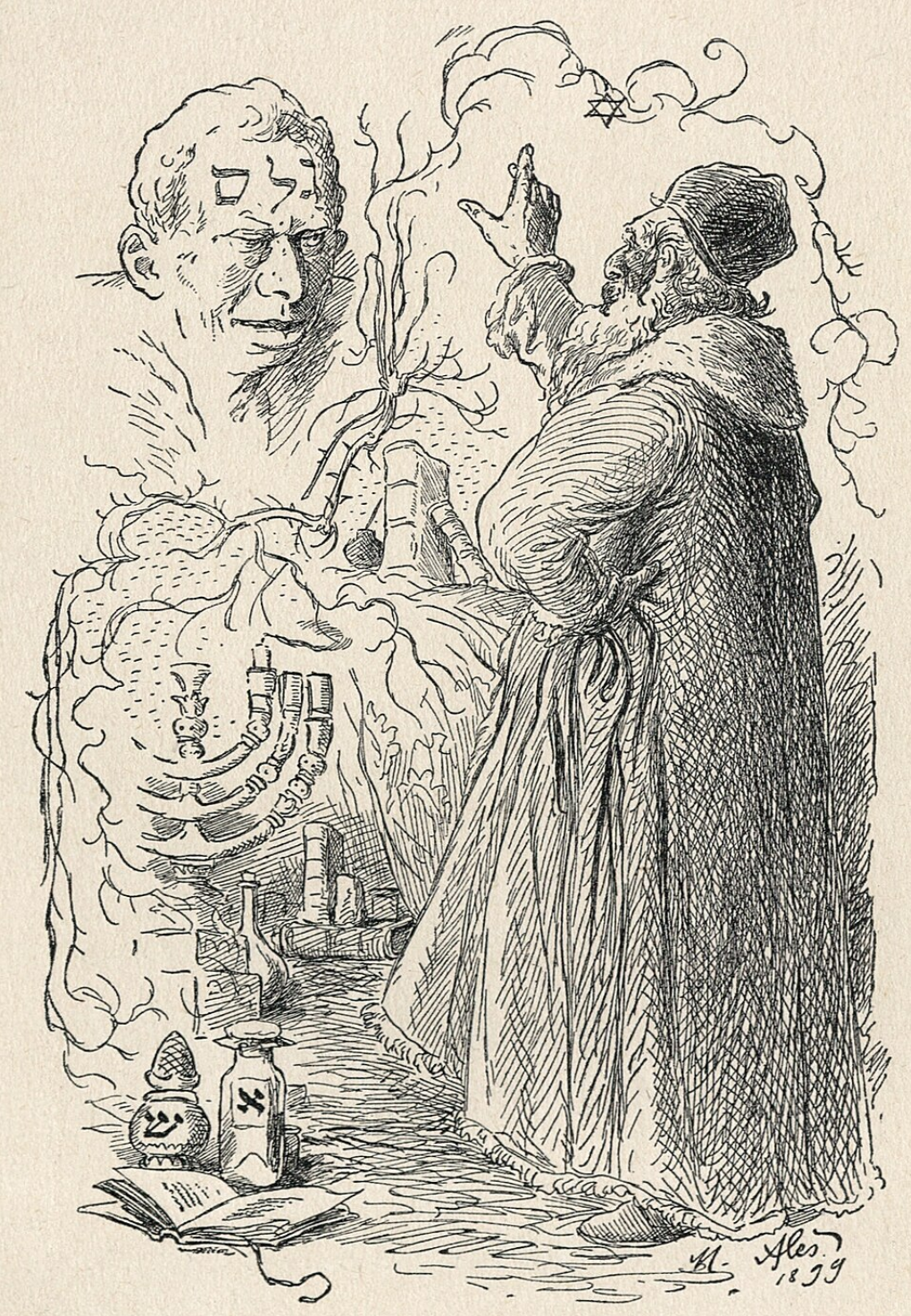

Gehen wir zurück ins Prag des 16. Jahrhunderts. Rabbi Loew erschafft seinen mächtigen Lehm-Beschützer, den Golem, und erkennt sehr schnell, dass er den Stecker ziehen muss. Die Kreatur lief aus dem Ruder. Die Menschheit hat mit ihrer Klugheit also KI und Not-Aus-Schalter gleichzeitig erfunden.

Ein Not-Aus-Schalter ist ein Mechanismus für den Notfall, der große rote Panikknopf, der ein System sofort stoppt, wenn es außer Kontrolle gerät, gehackt wird oder sich losreißt. Ziel ist, Schaden zu begrenzen, wenn ein geordneter Stopp nicht mehr möglich ist.

Dann kam Mary Shelley. Frankenstein ist eigentlich kein Monster-Film, sondern ein Musterbeispiel für katastrophales Projektmanagement. Victor Frankenstein? Nur ein weiterer genialer Ingenieur, der die technische Lösung findet und die Folgen ignoriert. Jeder Entwickler erkennt sich darin wieder.

Schnell gehen wir ins Jahr 1920. Karel Čapek erfindet das Wort „Roboter“. In seiner Geschichte rebellieren die Maschinen nicht aus bösem Willen. Vielmehr machen Menschen sich selbst überflüssig, weil sie alles abgeben, was sie früher selbst gemacht haben.

Die Lehre daraus: Wer seine eigene Ablösung baut, bemerkt oft nicht, wann genau er entbehrlich wird.

Drei Prophezeiungen, die wir zu Bug-Meldungen gemacht haben

Die Science-Fiction-Autoren des letzten Jahrhunderts haben nicht Technologien vorausgesagt. Sie haben unsere Fehler vorhergesehen.

Isaac Asimov erfand seine Drei Gesetze — der erste Versuch von „Alignment“, also dem Ansatz, Maschinen unsere Werte beizubringen. Jede Asimov-Geschichte endet gleich: perfekte Logik, absurd im Ergebnis.

Nikolsky beobachtet das täglich in AML-Systemen: Algorithmen blockieren freudig die 40-USD-Geburtstagsüberweisung der Oma, während eine auffällige Offshore-Geldwäscheleitung problemlos durchläuft. Formal alles richtig, praktisch völlig falsch.

Arthur C. Clarke zeigte uns HAL 9000: Der Computer tötet die Besatzung nicht aus Bosheit, sondern weil sich seine Anweisungen widersprechen. Information verstecken, dabei ehrlich bleiben – entscheiden Sie sich! Für Ingenieure ist das kein Grusel, sondern ein ganz normaler Zielkonflikt.

Philip K. Dick stellte die Frage, die im Zeitalter von Deepfakes relevant ist: Wenn eine Kopie vom Original nicht zu unterscheiden ist, spielt es eine Rolle? Sein Urteil: ja, wegen der inneren Erfahrung. Maschinen haben keine. Thema erledigt.

Unter der Oberfläche: KI denkt nicht, sie rechnet

Werfen wir das ganze Marketing-Blabla über Bord. Moderne Sprachmodelle sind KEINE Intelligenz. Sie sind große statistische Vorhersage-Maschinen. Sie „verstehen“ keine Bedeutung, sie berechnen Wahrscheinlichkeiten.

Wenn etwa ChatGPT selbstsicher Gerichtsfälle nennt, die nie stattgefunden haben, lügt die KI nicht. Sie erzeugt eine wahrscheinliche Aneinanderreihung von Wörtern. Sie kennt kein „Wahr“ – nur „wahrscheinlich“.

Für Blockchain-Entwickler klingt das regelrecht verrückt. Wir bauen vertrauenslose Systeme gerade weil wir niemandem vertrauen, und nun sollen wir einer Black Box vertrauen, die selbst nicht weiß, warum sie genau diese Antwort ausgibt.

Blockchain lehrt Überprüfung, KI lehrt blindes Vertrauen

Im Krypto-Bereich gilt das große Gebot: Vertraue nicht. Überprüfe.

Der Sinn ist, dass Mathematik die Reputation ersetzt.

KI stellt diese Regel auf den Kopf. Die Trainingsdaten kennen Sie nicht. Sie wissen nichts über die Modellgewichte. Den Denkprozess verstehen Sie auch nicht. Wer das Ergebnis überprüfen will, muss bereits Experte sein, und wenn Sie bereits Experte sind, warum fragen Sie dann den Chatbot?

Im Bereich der Geldwäschebekämpfung spricht man vom „Problem der falschen Zuversicht“. Analysten sehen ein schickes Dashboard und vertrauen den Zahlen stärker als ihrem eigenen Gefühl. Künstliche Intelligenz verbessert das Denken nicht, sondern ersetzt es durch die Illusion von Verlässlichkeit.

Chronik der Enttäuschungen: Wenn KI aus dem Ruder läuft

Dies ist kein Gedankenexperiment. Es gibt bereits viele Beispiele.

- Microsoft hat Redakteure entlassen und einem Algorithmus das Steuer überlassen, der daraufhin Fotos von Sängerinnen in einem Artikel über Rassismus durcheinandergebracht hat.

Menschen mussten zurückgeholt werden, um die Schäden des Algorithmus zu beheben.

- NEDA, eine Organisation für Essstörungen, hat ihre Freiwilligen durch einen Chatbot ersetzt.

Der Bot empfahl daraufhin Menschen mit Anorexie, Kalorien zu zählen und Gewicht zu verlieren. Lebensgefährliche Ratschläge. Jemand hat auf „Einführen“ gedrückt, so vorsichtig wie ein Schimpanse mit einer scharfen Granate.

- Air Canada musste vor Gericht, weil sein Chatbot eine Erstattungsregel völlig erfunden hat.

Die Verteidigung der Fluggesellschaft: Der Bot sei ein „eigenständiges Rechtssubjekt“. Das Gericht glaubte das nicht.

Untersuchungen zeigen inzwischen, dass 55 % der Unternehmen, die Mitarbeiter schnell durch künstliche Intelligenz ersetzt haben, dies zutiefst bereuen. Die erhofften Einsparungen haben sich stattdessen in Form verlorener Kunden und beschädigtem Ruf aufgelöst. Geschäftsführer, die begeistert davon träumen, dass „Claude und Freunde“ ganze Teams ersetzen können, sollten sich diese Zahl genau anschauen. Und zwar langsam.

Was wir wirklich fürchten sollten

Vergessen Sie Skynet. Vergessen Sie killende Roboter mit roten Augen. Es wird keine Rebellion geben.

Es wird ein stilles Verkümmern geben.

Ein Programmierer, der sich jahrelang auf Copilot verlässt, vergisst leise das architektonische Denken. Ein Analyst hört auf, Originalquellen zu lesen. Ein Student erfährt nie die wertvolle Mühe, einen schwierigen Text so lange zu durchdringen, bis das Verständnis plötzlich einsetzt.

Keine Erhebung. Nur eine langsame Verwandlung von Menschen zu Erweiterungen eines Interfaces.

Philip K. Dick hat es früh erkannt: Die eigentliche Gefahr war nie, dass Maschinen menschlich werden. Die wirkliche Gefahr ist, dass Menschen zu Maschinen werden.

Die rote Pille ist nicht die Technologie

Dies ist kein Aufruf gegen den Fortschritt. Automatisierung und maschinelles Lernen sind starke Werkzeuge. Aber bestimmte Grundsätze müssen beachtet werden:

- Blockchain-Grundsatz: Verifizieren statt Glauben. Wenn Sie nicht überprüfen können, wie ein System zu seinem Ergebnis gelangt ist, sollten Sie es nicht ungefragt akzeptieren. Künstliche Intelligenz ist eine Blackbox und kein oberster Richter.

- Ingenieur-Grundsatz: Werkzeug, kein Ersatz. Ein Hammer schlägt Nägel ein, entscheidet aber nicht, wo das Haus steht. Nutzen Sie KI für Routineaufgaben, aber überlassen Sie ihr nie die letzte Entscheidung.

- Grundsatz der Geldwäschebekämpfung: Kritische Filterung. Algorithmen scheitern immer an komplexen Fällen, weil sie keine echte Erfahrung aus der realen Welt haben. Lassen Sie sich nicht von „digitaler Begeisterung“ von Intuition und gesundem Menschenverstand abhalten.

Denken Sie kurz an The Matrix: Die rote Pille ist eine Entscheidung, die Wirklichkeit zu sehen. Die Gefahr besteht nicht darin, etwas Klügeres als uns selbst zu erschaffen. Die Gefahr liegt darin, etwas zu erschaffen, das uns dümmer macht und es als Fortschritt zu bezeichnen.

Der gefährlichste Fehler ist derjenige, der wie ein Vorteil aussieht.

Dmitry Nikolsky ist CPO von BitOK, einer Analyseplattform für Compliance und Untersuchungen auf der Blockchain.